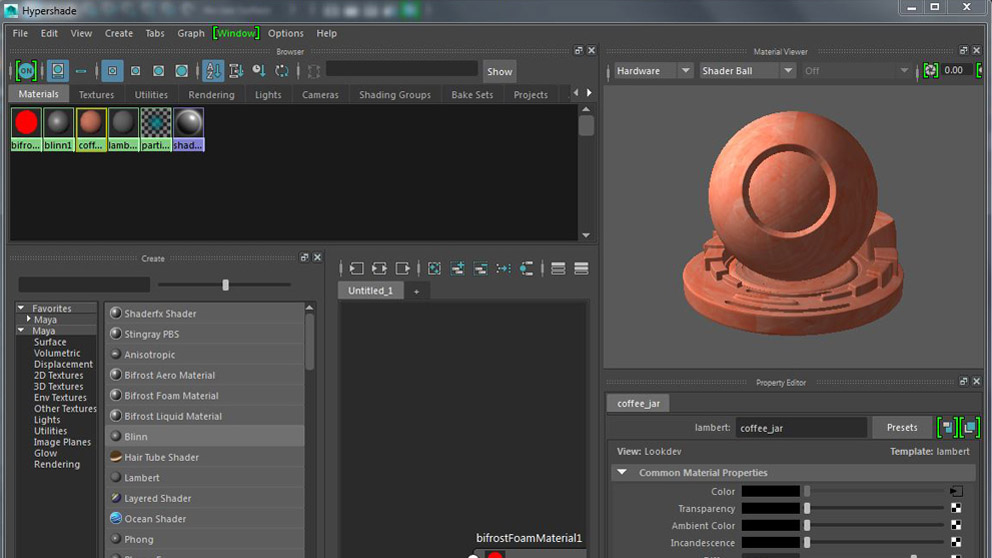

Jedem Modell kann ein einfaches Material zugewiesen werden, welches die Farbe und die äußere Erscheinung durch konfigurierbare Eigenschaften wie Mattheit, Transparenz, Rauheit und Leuchteffekte bestimmt.

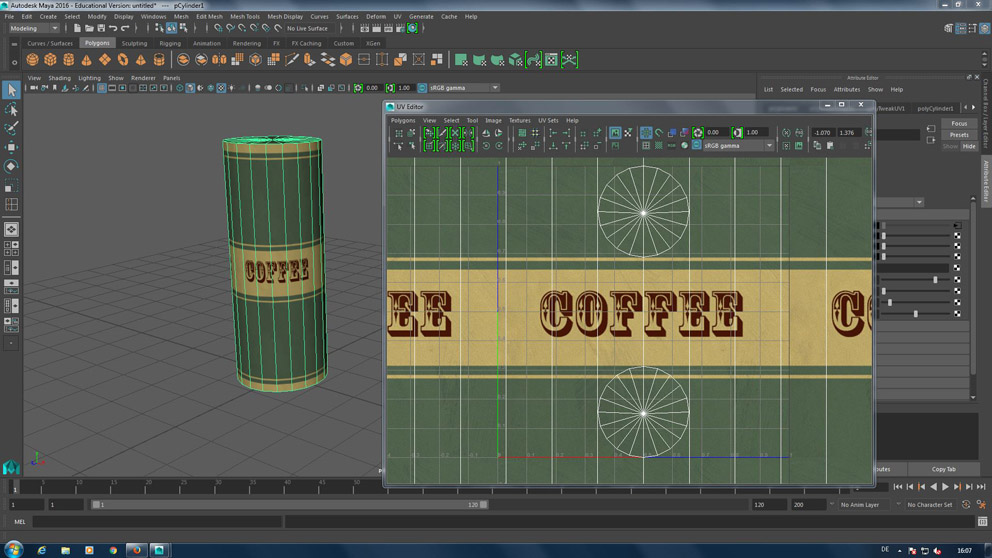

Soll das Modell mehr als eine Farbe haben, oder eine Textur benötigen, ist es wichtig die genaue Position der Polygone zu wissen, um sie zu einzufärben. Dafür wird die gesamte Gitteroberfläche des Objekts zweidimensional auf eine Ebene projiziert, im sogennannten UV-Editor. Projektionen können automatisch erstellt werden, je nach Grundform des Objekts, oder manuell „aufgeschnitten“ werden, so dass am Ende eine Map von dem Objekt entsteht. Über ein Screenshot kann dieses sogenannte UV-Map nach Photoshop exportiert werden, um die entsprechenden Polygone zu lokalisieren und zu bemalen. Diese fertige Grafikdatei wird Textur genannt, und kann dem entsprechenden Material zugewiesen werden. Für Texturmuster werden häufig hochaufgelöste Fotos verwendet.

Anfänger werden schnell dazu verleitet, den einzelnen Polygonen im Maya unterschiedliche Materialien zuzuweisen, um sie innerhalb des Programms selbst einzufärben und so den Arbeitsschritt über die UV-Maps und Texturerstellung zu umgehen. Dabei handelt es sich nicht um sauberes oder übersichtliches Arbeiten. Bei komplexen Modellen wird dieser Vorgang zudem keine Zeitersparnis sein, da man hier schnell den Überblick verliert, welchen Flächen welches Material zugewiesen wurde. Im Hypershade Editor kann eingesehen werden, welche Materialien zu welchem Objekt gehören, aber es gibt keine Information über die einzelnen Polygone. Daher sollte man diese Vorgehensweise vermeiden.

Im UV-Editor wird die Textur größentechnisch angepasst und die UV-Maps werden so verschoben, dass auf dem Objekt das gewünschte Motiv gezeigt wird. Für die Anpassung wird oft die standartisierte Checker-Textur genutzt, um Verzerrungen in der finalen Textur auszuschließen. Mit dieser Oberfläche können leicht eventuelle Unregelmäßigkeiten in den Größenverhältnissen ausgeglichen werden.

Wenn die Textur über den Rand des Editors geht, wird das Bild automatisch repliziert und es entsteht ein sich widerholendes Muster. Daher ist es oft wichtig, dass die Nahtstellen des Musters zusammenpassen. Diese lassen sich in Photoshop bearbeiten.

Beleuchtung und Rendering

Maya bietet eine Reihe von Lichtquellen, vom Spotlight, das eine bestimmte Richtung hat und das Objekt gezielt mit einem relativ abgegrenzten Lichtkegel beleuchten kann, über das Point Light, das nach allen Richtungen die gleiche Lichtmenge ausstrahlt, das Directional Light, mit der Tageslicht gut simuliert werden kann etc. Grundsätzlich wird ein Objekt mit drei Lichtquellen ausgeleuchtet: das Key Light = Hauptlichtquelle, das Fill Light, das dazu dient, die Schatten des Objekts auszuleuchten und oft auch einzufärben oder eine Farbe zu verstärken und abzumildern, sowie das Rim Light, eine Lichtquelle, die oberhalb oder hinter dem Objekt positioniert wird, um seine Kanten hervorzuheben. In der Praxis sind jedoch oft viele zusätzliche Lichter notwendig, um Details hervorzuheben. Oft wird auch mit einem HDRI Environment Map gearbeitet, einer Textur, dessen Lichtinformationen auf Fotoaufnahmen von Landschaften oder Himmelsaufnahmen beruhen, die man je nach Stimmung auswählen kann: Sonnenuntergang, klarer Himmel, Waldlandschaft etc.

Die gewählte Lichtinformation wird als Textur einer Sphäre eingesetzt, welche die gesamte Szenerie umschließt. Diese Quelle bietet eine einheitliche Basis für die Szene und verleiht ihr Atmophäre, so dass die Lichter nun gezielter eingesetzt werden und auf die vorhandene Beleuchtung aufgebaut werden kann. Sind die Beleuchtung und die Animation abgeschlossen, muss die Szene aus Maya heraus mit einer virtuellen Kamera als Film ausgegeben werden. Dieser Vorgang wird als Rendering bezeichnet.

Wie bei der 2D-Animation wird der 3D-Shot Image für Image herausgegeben. Die Frames zusammen können in einem Postproduktionsprogramm als beweglicher Film eingelesen werden. Hier wird noch einmal überprüft, ob die Aufnahme verwendbar ist, oder ein neues Rendering notwendig ist. In einem 3D-Programm ist es möglich, die Einzelteile der Szene auch einzeln zu rendern, und diese erst in der Postproduktion zusammen zu montieren. Jeder Charakter oder sogar Teile eines Charakters können so ausgewählt werden, dass sie jeweils eine eigene Bildspur bekommen.

Composition und Postproduktion

Die finale Montage des Bildes aus Hintergrund, Charakteren und weiteren Elementen findet in einem Programm wie Nuke statt. Hat man den 3D-Charakter allein gerendert, kann in Nuke auch ein Photoshop-Bild, z.B. eine Matte Painting als Hintergrund hinzugefügt werden. Zudem werden hier auch die finalen Farbkorrekturen und Helligkeitsregelungen gemacht. Der Schnitt wird mit einem Programm wie Adobe Premiere fertiggestellt.

Artikel und Abbildungen: Nika Robin