Dank Artificial Intelligence und neuen Videotools ist es kinderleicht geworden, Videos zu fälschen. Besonders beliebt: Fake Pornovideos mit Promis. Plötzlich tauchen dank AI zahlreiche ziemlich echt aussehende, manipulierte Sex-Videos von amerikanischen Promis auf, bei denen Videoaufnahmen der Stars mit irgendwelchen Sexvideos kombiniert wurden. Opfer sind unter anderem Schauspielerinnen wie Scarlett Johansson, Taylor Swift und Emma Watson. Aber auch zahlreiche Privatpersonen müssen die denunzierende Rache ihrer Verflossenen in Form von Pornostreifen mit ihrem Konterfei erleiden. Revenge-Porn nennen das die Amerikaner, womit sowohl Privataufnahmen, die nicht für die Öffentlichkeit gedacht waren, als auch neuerdings dreiste Fälschungsvideos gemeint sind, die plötzlich im Internet die Runde machen.

Pandoras Büchse

Die geschriebene Lüge ist so alt wie die Schrift, Propaganda in Wort und Bild gibt es seit dem Buchdruck. Bildmanipulationen sind schon lange möglich, doch wenn man sie für Videos bewerkstelligen wollte, etwa um ein anderes Gesicht in eine vorhandene Videoaufnahme sauber einzubauen, war dafür ein großer Aufwand notwendig. Schließlich mussten die Bildkompositionen Bild für Bild mit aufwändigen Masken und Retuschen bewerkstelligt werden.

SFX Artists wären lange mit so etwas beschäftigt, doch seit Januar 2018 gibt es Apps, die diesen Job automatisieren und die Videofälschungen mit hoher Präzision ermöglichen. Im Grunde genommen hat Snapchat das Verfahren in einer primitiven Variante schon seit Jahren angeboten und auch Apps wie FaceApp, bei denen man sein eigenes Gesicht verjüngen oder altern lassen kann, verwendeten ähnliche Techniken.

2017 hatte die Universität in Washington es mit Hilfe von Artificial Intelligence geschafft, Gesichtsmimik und Lippenbewegungen eines Videos von Ex-Präsident Obama auf einen nur als Tonaufnahme vorhandenen Text von ihm automatisch zu synchronisieren. Das Ergebnis war überzeugend.

Ein anonymer User der sich "Deepfakes" nennt, hat im Dezember 2017 auf Reddit erläutert, wie er derartige Manipulationen mit Hilfe von Analysetools und freier Software bewerkstellige, wobei die Aufgabe der Artificial Intelligence vor allem darin besteht, für die gewünschte zu fälschende Videosequenz passende andere Videos zu finden, in denen die Gesichter und Bewegungen der Promis oder Privatpersonen in ähnlichem Bildwinkel, ähnlichem Licht und mit ähnlichen Bewegungen zu sehen sind.

Alles ist vergiftet

Eigentlich war in Zeiten von Fake-News und Bots nicht mehr allzu viel übrig, dem man im Internet vertrauen konnte, Videos gehörten mehr oder weniger noch zu dem, wovon man wusste, dass Laien sie nicht so leicht manipulieren konnten. Das hat sich grundlegend geändert. Der Grundsatz "Ich glaube nur, was ich sehe" hat seine Basis in Bezug auf Videos quasi über Nacht veroren. Die Verfügbarkeit zahlloser Videos von Personen öffentlichen Interesses eröffnet potentiellen Manipulationen schier unbegrenzte Möglichkeiten. Während man früher bei der Suche nach den Urhebern derartiger gefälschter Videos den Kreis sehr genau auf professionell Firmen eingrenzen konnte, kommt mit den neuen Techniken nahezu Jeder als Hersteller in Frage.

In einer Zeit, in der Wutbürger und Hassprediger ihre Meinungen durch das Internet posaunen, in der Mitschüler es als Gag empfinden, Andere aus ihrer Schule per Social Media zu denunzieren, sind die Chancen, dass die neuen Video-Manipulationsverfahren erheblichen Schaden anrichten werden, sehr groß. Neben moralischen Angriffen auf Prominente können natürlich auch Politiker durch gefälschte Videoaufnahmen diskreditiert werden.

Wo die Promis zumindest die Presse und Anwälte zur Verfügung haben, sich zu wehren, sind Privatpersonen zumeist schutzlos den Angriffen ausgeliefert. Andererseits sind die Rechte auf Privatheit bei "Personen öffentlichen Interesses" oftmals schwer einzuklagen, weil die Videos dieser Personen ja bewusst für den freien Zugang durch die Öffentlichkeit publiziert wurden.

Viele der anonymen Urheber gefakter Videos reklamieren für sich, dass sie eine neue Technologie kreativ nutzen würden und keinerlei Absichten hätten, Jemand zu schaden. Eine schwierige Argumentation, schließlich werden Videos im Web so oft vervielfältigt, dass man sie praktisch nicht mehr löschen kann, selbst wenn man den oder die Urheber ausfindig gemacht hat.

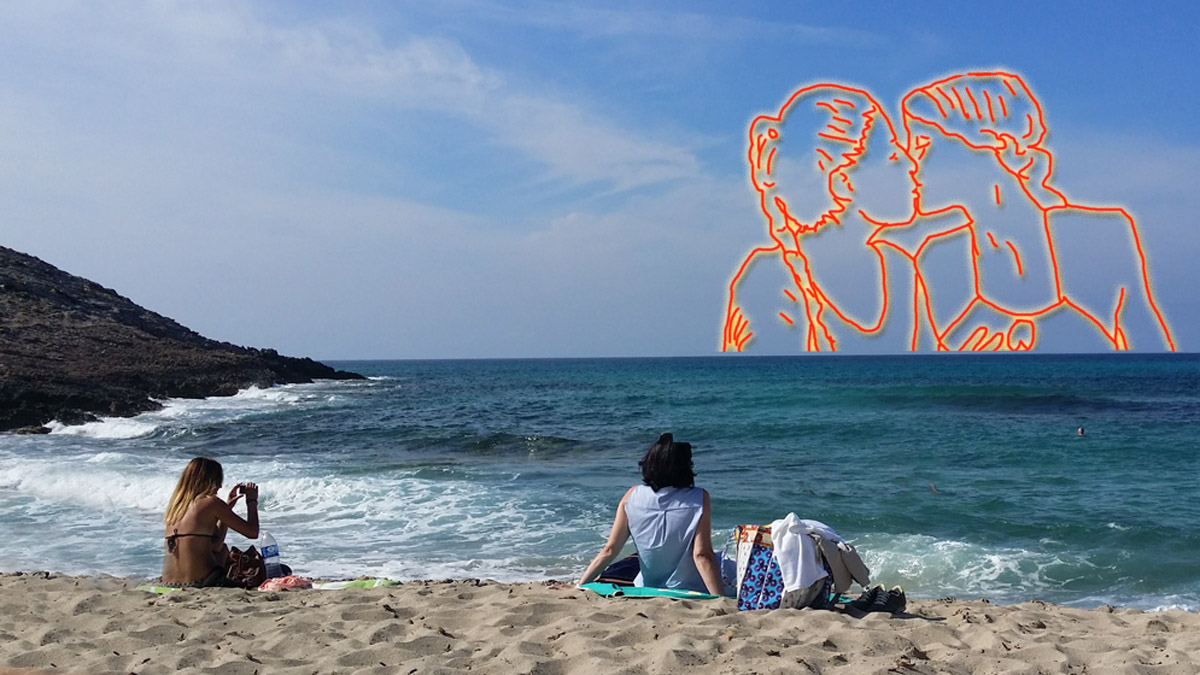

Fast scheint es, als wenn das Web auf derartige Fälschungen noch gar nicht vorbereitet ist, jedenfalls gibt es noch keine Software, die derartige Manipulationen automatisch erkennt. Bei den neuen Systemen sind auch die Kanten an denen die zusammengesetzten Bildebenen aufeinander treffen, viel sauberer in den Übergängen, als etwa bei dem Bild über diesem Text, wo man besonders bei den Haaren gut erkennen kann, was hinzugefügt wurde.

Der Umgang mit dieser neuen Art der Bedrohung von Wahrheit muss erst noch erlernt werden. Unsere Kritikfähigkeit, unser wacher Zweifel und unser gesunder Menschenverstand werden in Zukunft auf noch härtere Proben gestellt. Facebook, Youtube & Co werden uns diese Aufgabe nicht abnehmen.